前言

前一段时间,我所在省份国补和教育优惠也能叠加使用了,遂跟风买了一台丐版 2024 款 Mac mini。最近 DeepSeek 比较火,M4 高达 38TOPS 的 AI 算力跑点比较轻量的 AI 模型不成问题。博客鸽了这么久没更新,也该水一篇文章了。

安装 Ollama 并运行

Ollama 是一款常用的大模型部署工具,很容易上手。

首先打开 Ollama 官网,选择 macOS 下载安装包,双击解压。然后把解压得到的 Ollama 应用拖到访达侧边栏的“应用程序”中即可。然后打开启动台就能看到 Ollama 的图标了,单击运行即可启动。

在 Ollama 模型库 中搜索你想要的模型。模型的参数量越大就越聪明,但也需要更多的内存。一般来说,选择参数量小于内存大小的模型即可。

由于我的 2024 款 Mac mini 内存只有 16G,最高只能运行 DeepSeek R1 14b 模型。如果你的设备又有更大的内存,完全可以运行更高参数的模型。

打开终端并执行以下命令:

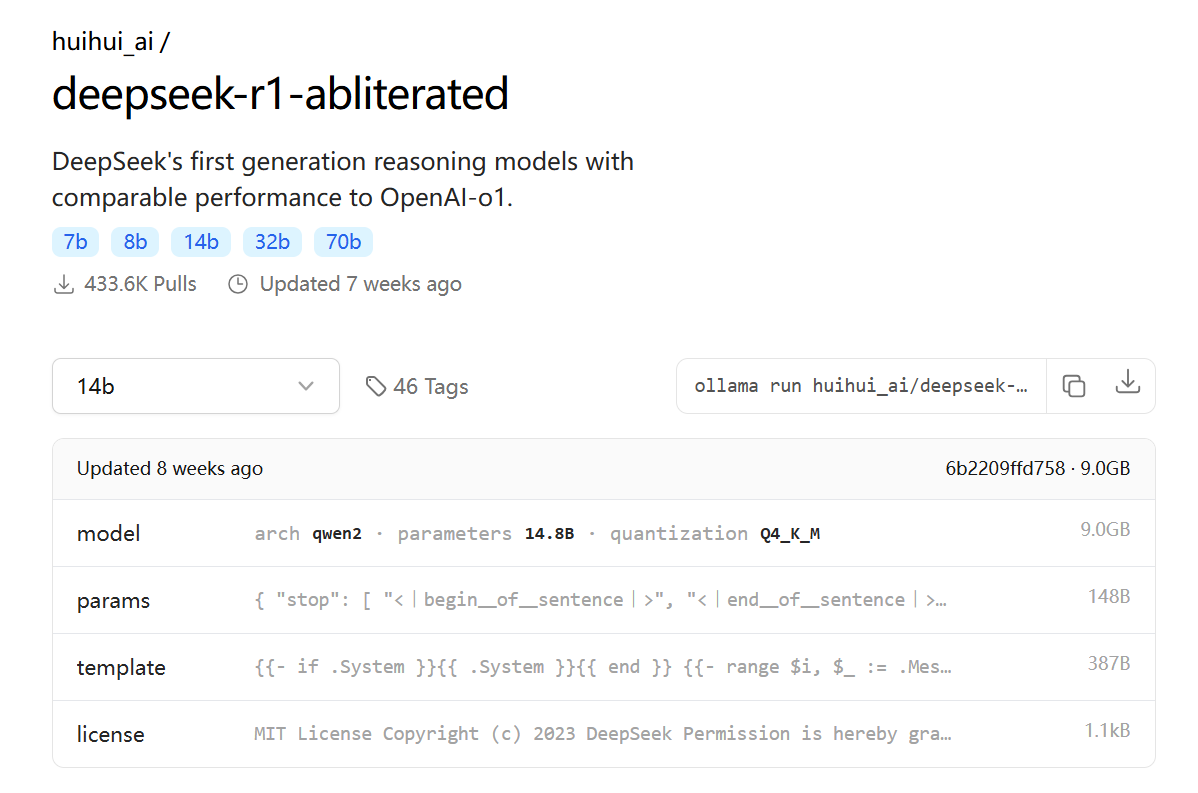

运行无审查版(越狱版) DeepSeek R1 模型:

ollama run huihui_ai/deepseek-r1-abliterated:14b(或)如果你想使用官方版 DeepSeek R1,使用以下命令即可:

ollama run deepseek-r1:14b

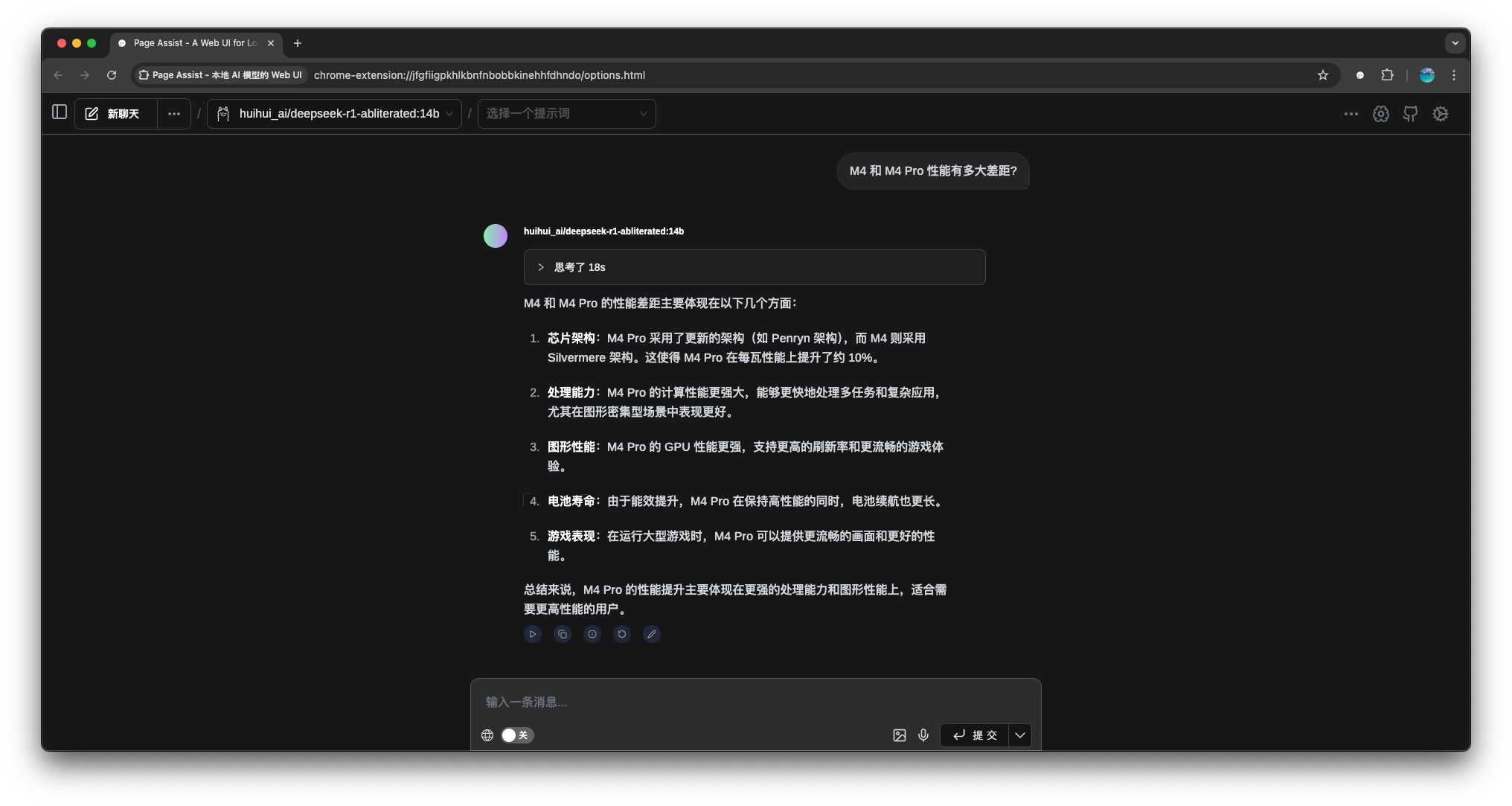

然后就可以在命令行上和 AI 交互了。实测输出速度在 11 tokens/s,考虑到 M4 芯片功耗极低,这个速度还是可以的。如需退出,输入 /bye 即可。

提示当然你也可以尝试其他模型,比如谷歌新发布的 Gemma 3,实测运行 12b 参数的模型完全没问题。

但是这种命令行式的对话体验并不友好,所以建议使用第三方工具进行调用。

安装可视化聊天界面

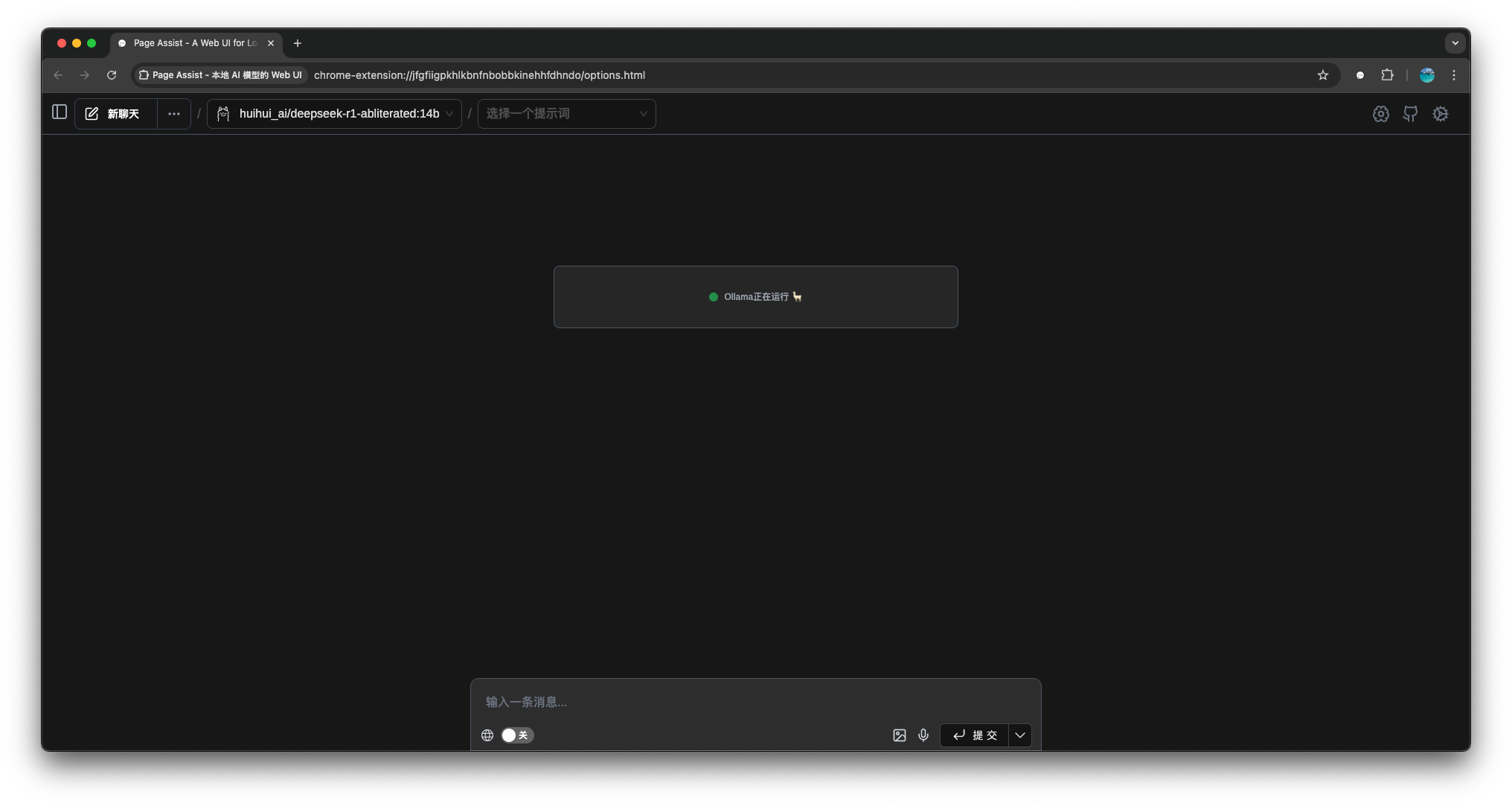

浏览器插件 Page Assist 是我比较常用的 Ollama Web UI,可以给本地部署的大模型提供一个直观的界面。

根据你使用的浏览器进行下载:

安装后可以将其固定到工具栏,更方便打开。

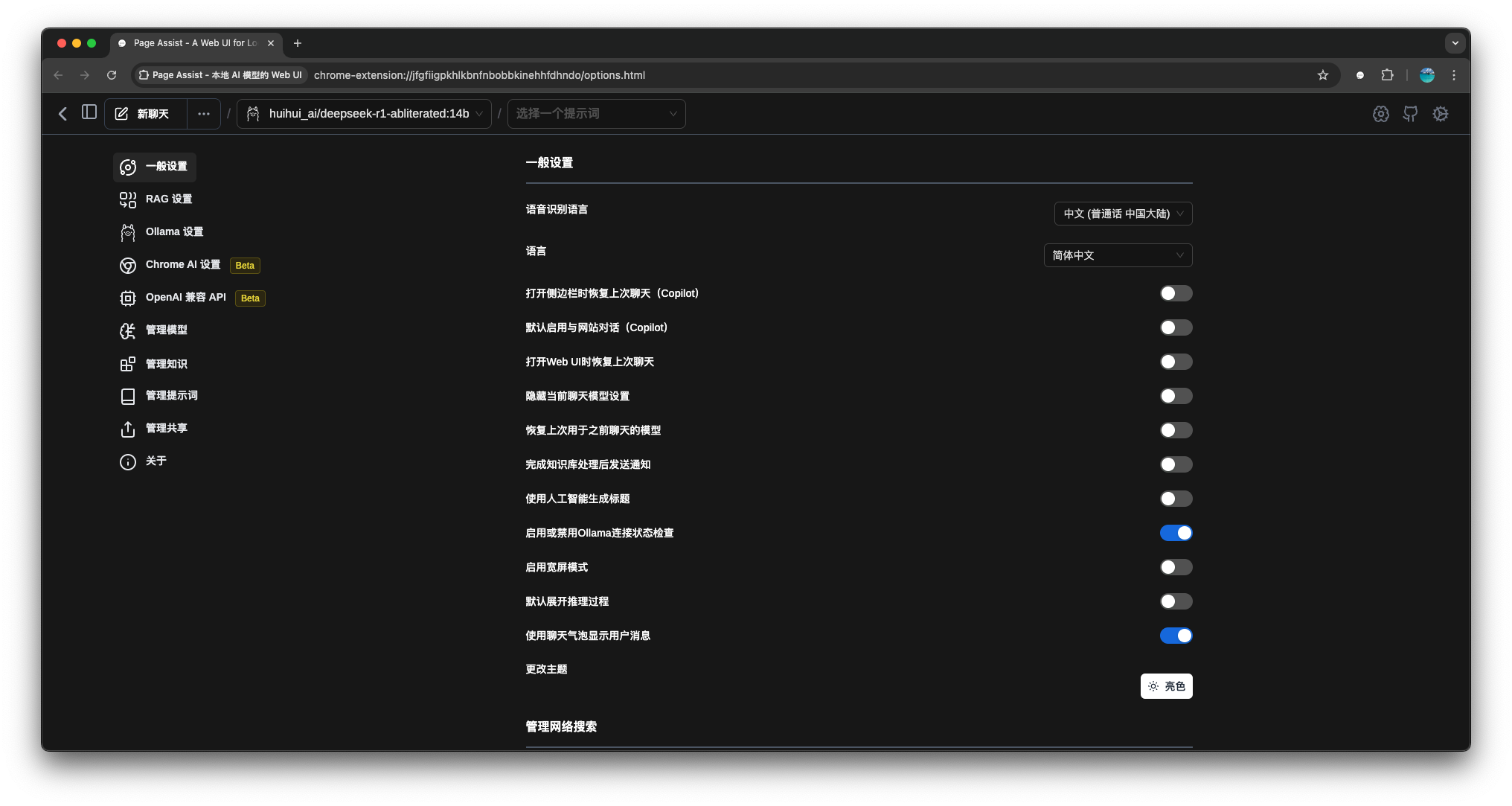

点击右上角的设置按钮,可以更改语言。

然后在顶部选择之前下载的模型,即可开始使用。另外,底部聊天框处可开启联网搜索功能,回答更精准。默认搜索引擎为 DuckDuckGo,可在设置页面进行修改。

其他工具推荐

- Chatbox AI(支持桌面端、移动端、网页端)

- Cherry Studio(仅支持桌面端)

设置环境变量

使用以下命令设置两个环境变量,允许局域网内的其他设备访问 Ollama API。

launchctl setenv OLLAMA_HOST "0.0.0.0"

launchctl setenv OLLAMA_ORIGINS "*"设置开机自启动及局域网访问

我们在上一步手动设置了环境变量,但是在重启或退出登录后会失效。因此我们需要创建一个启动脚本,在登录系统时自动设置环境变量并启动 Ollama,同时删除安装时生成的“Ollama”的登录项。

以下为详细步骤:

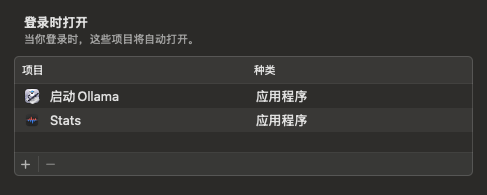

首先打开“系统设置”-“通用”-“登录项与扩展”,删除“登录时打开”中名为“Ollama”的登录项,我这边就不放图了。

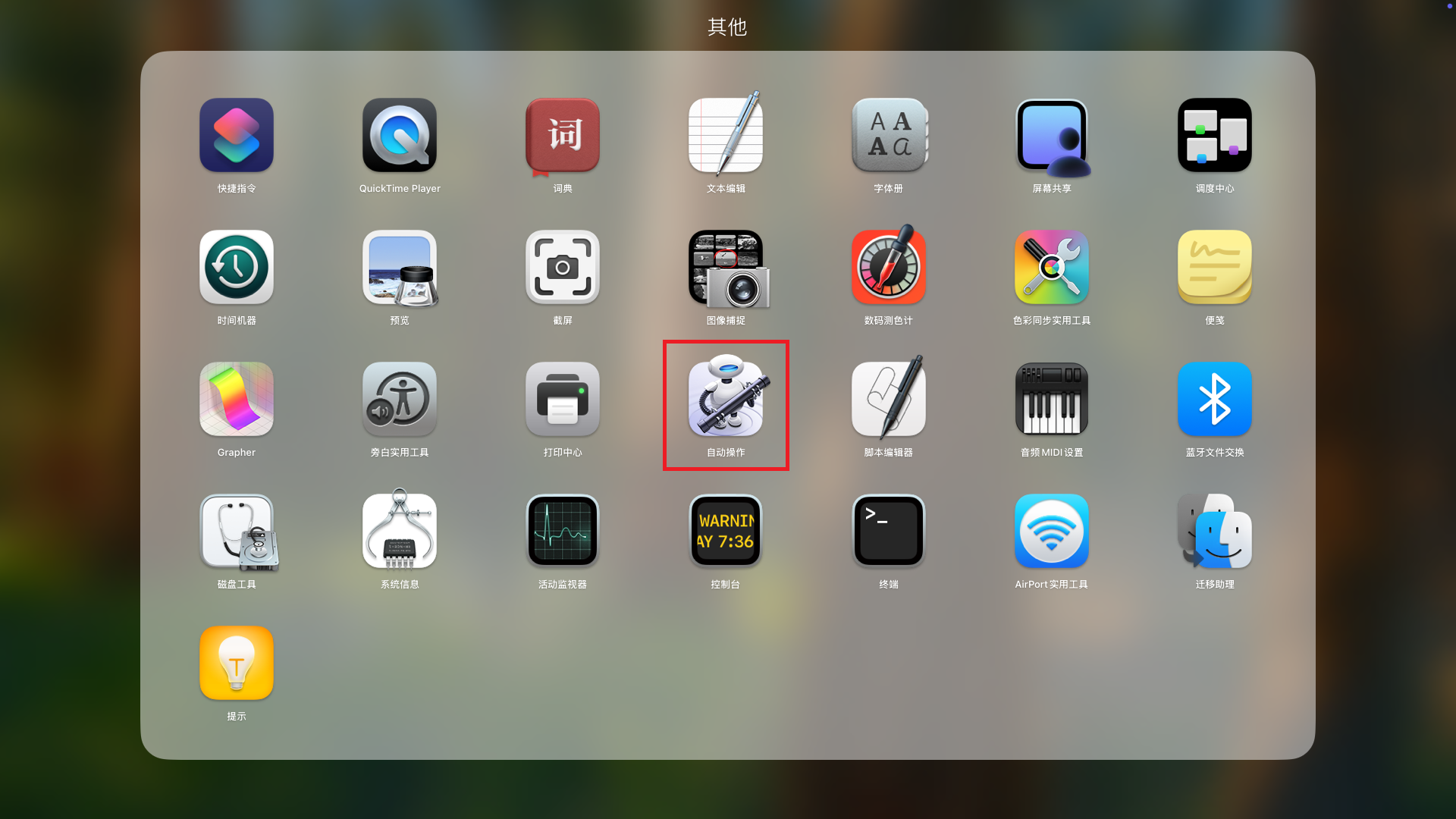

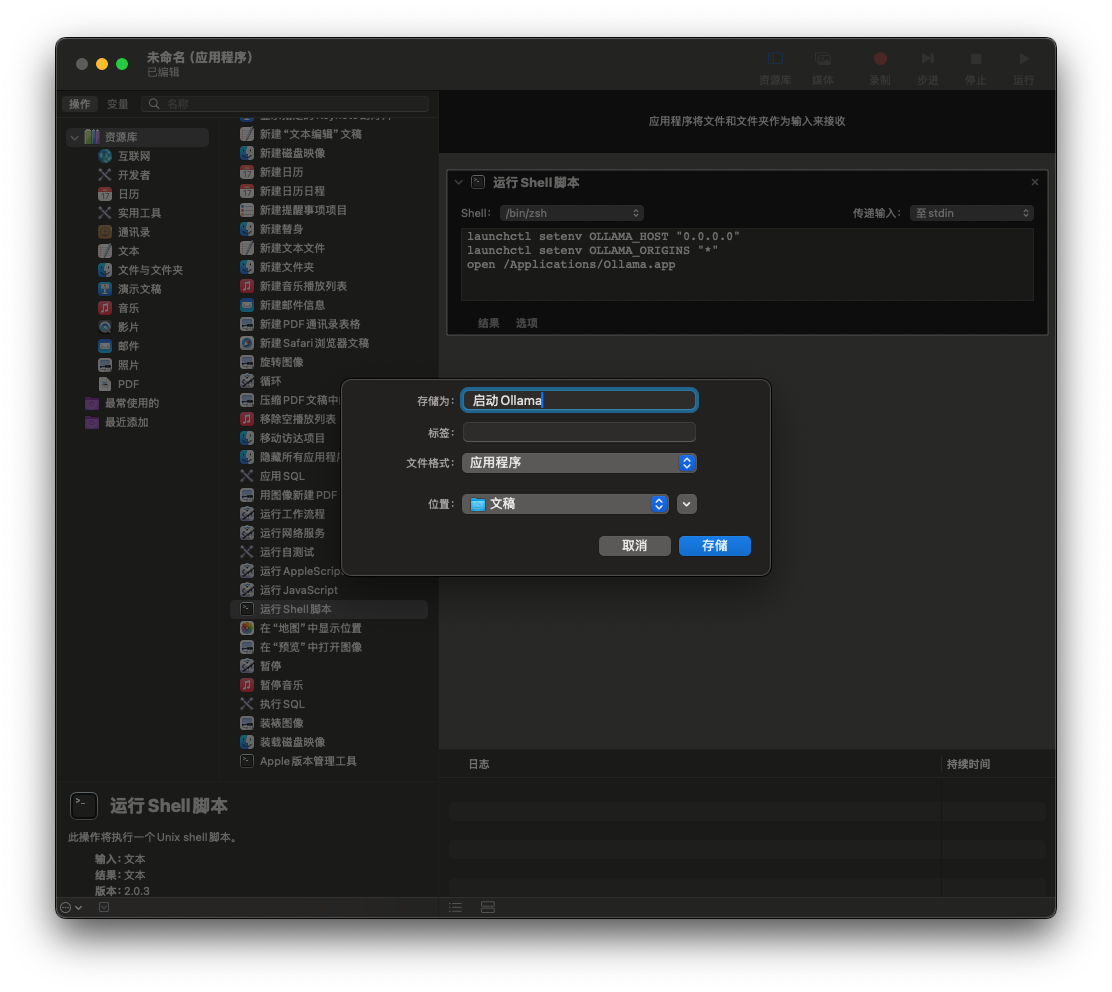

然后打开“自动操作” App

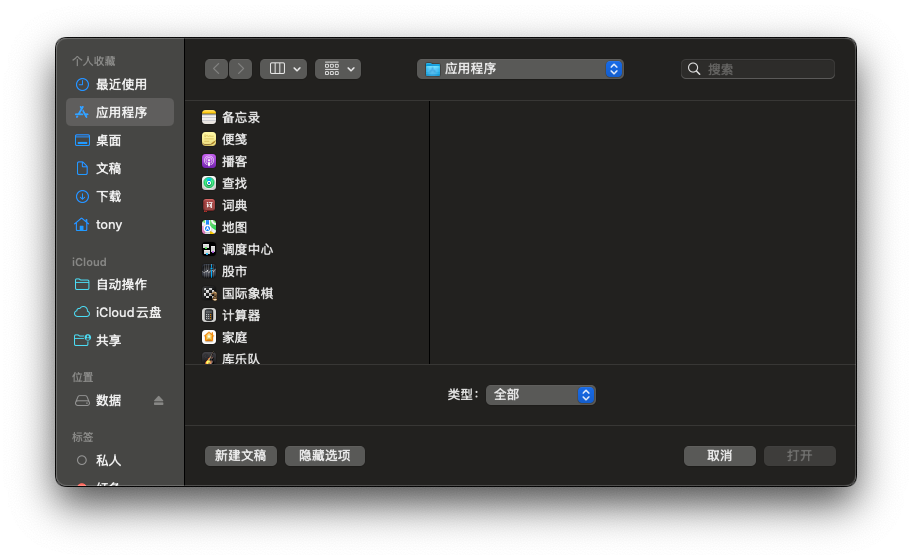

点击“新建文稿”

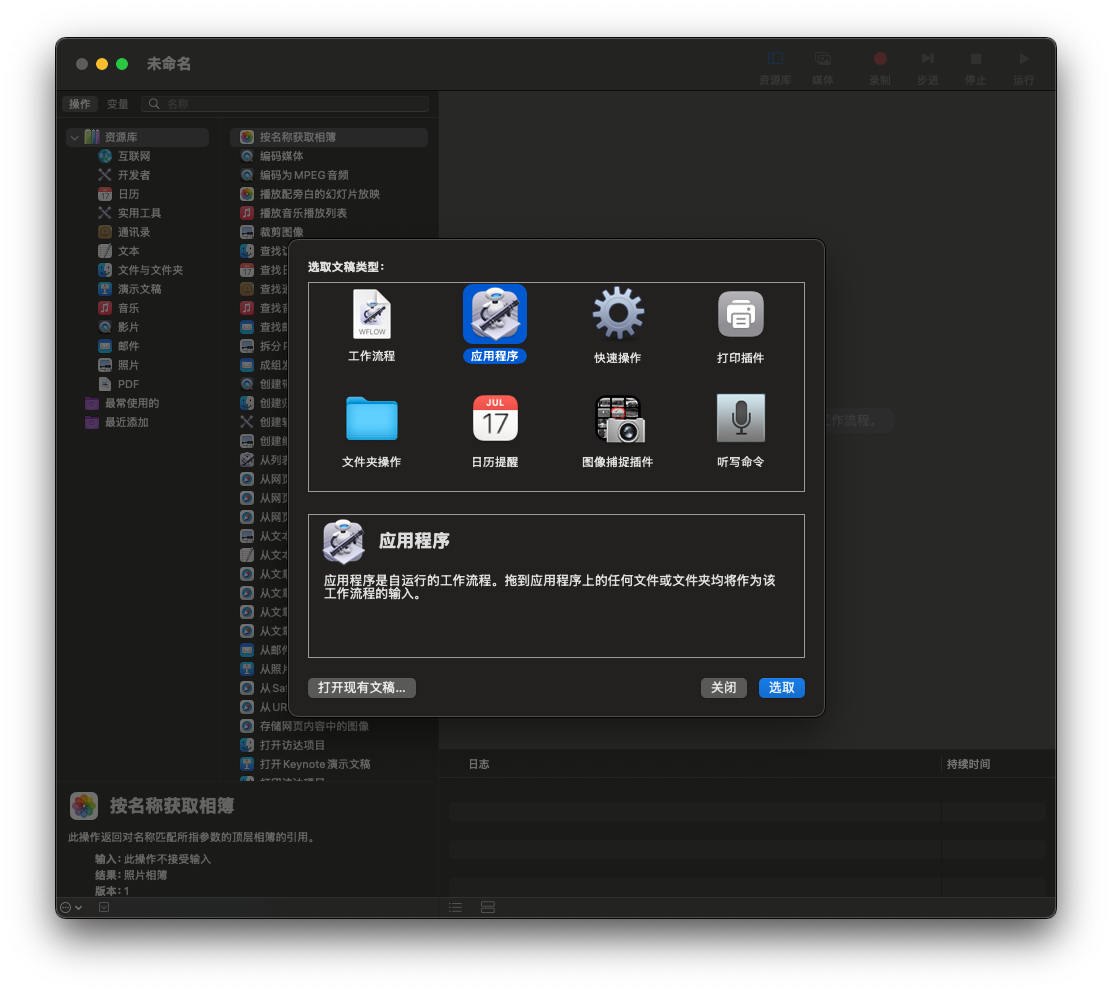

选择“应用程序”,并点击“选取”

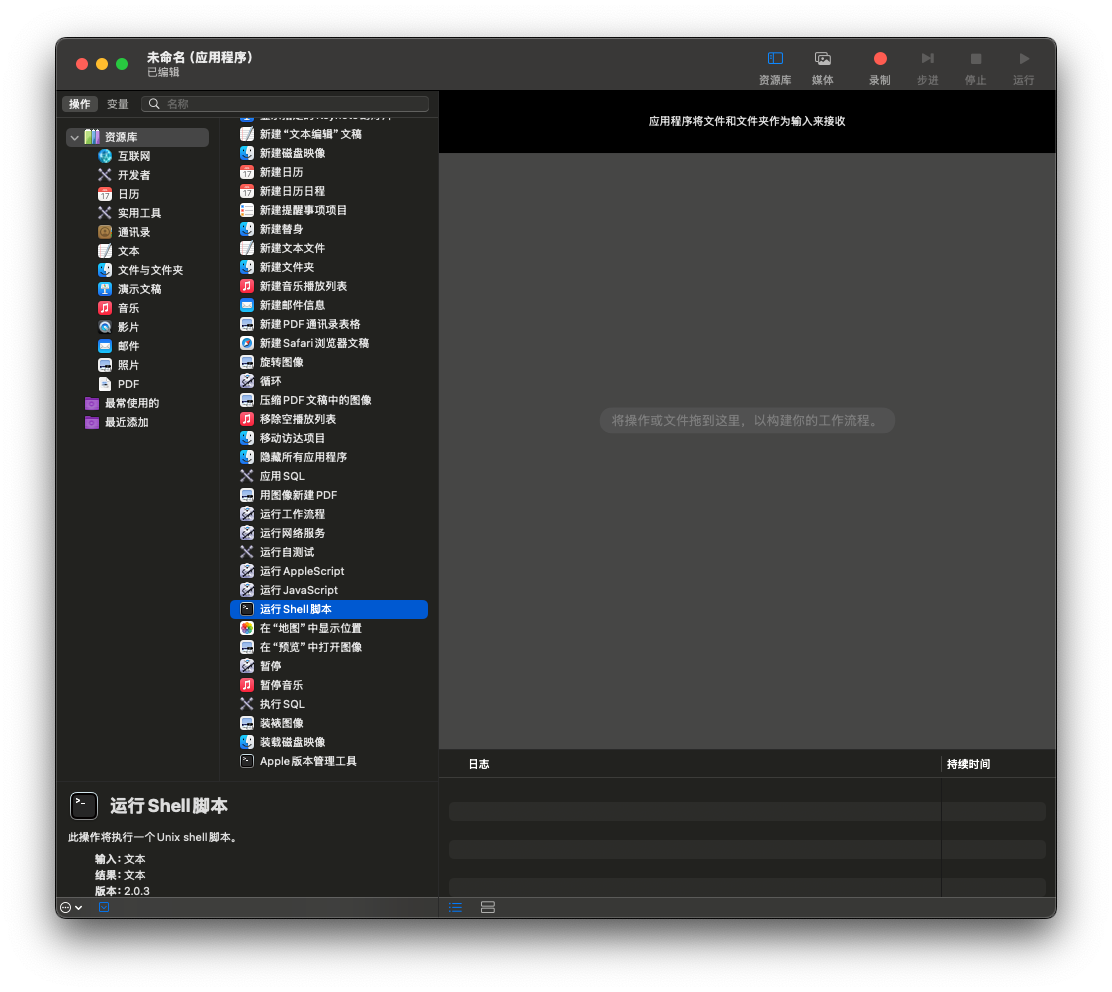

找到“运行 Shell 脚本”这个项目,并将其拖到右侧空白处。

删除原有内容,并粘贴以下内容:

launchctl setenv OLLAMA_HOST "0.0.0.0"

launchctl setenv OLLAMA_ORIGINS "*"

open /Applications/Ollama.app

然后点击左上角菜单栏的“文件”-“存储”。

指定文件名和保存位置,例如:

然后打开“系统设置”-“通用”-“登录项与扩展”,点击“登录时打开”中的加号,选择刚刚创建的脚本,点击“打开”。

添加完成。

然后重新登录或重启 macOS ,Ollama 就会自动启动了。

然后我们可以在局域网内的其他设备上安装第三方工具进行调用,仅需指定 API 地址即可。

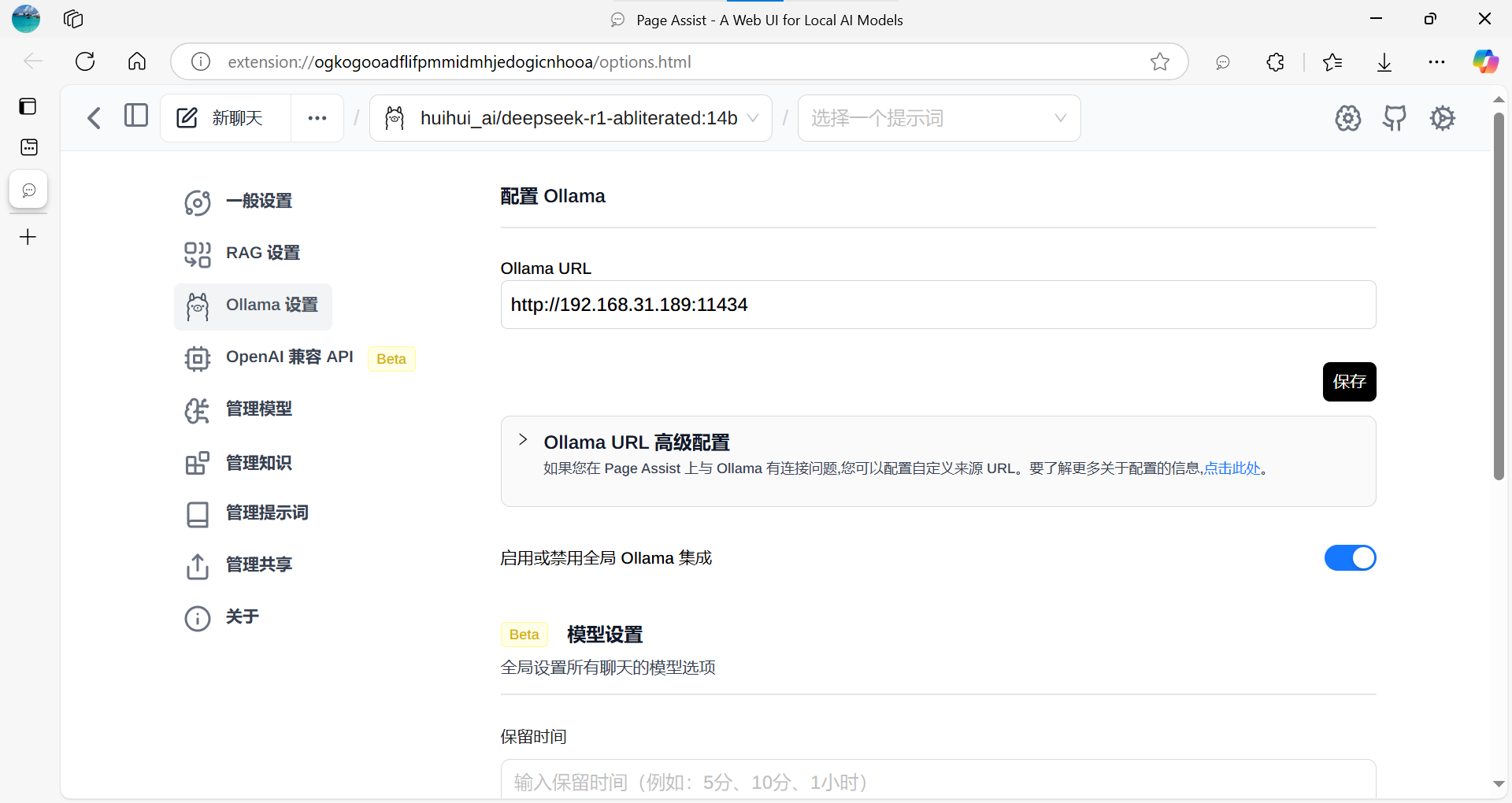

Page Assist:

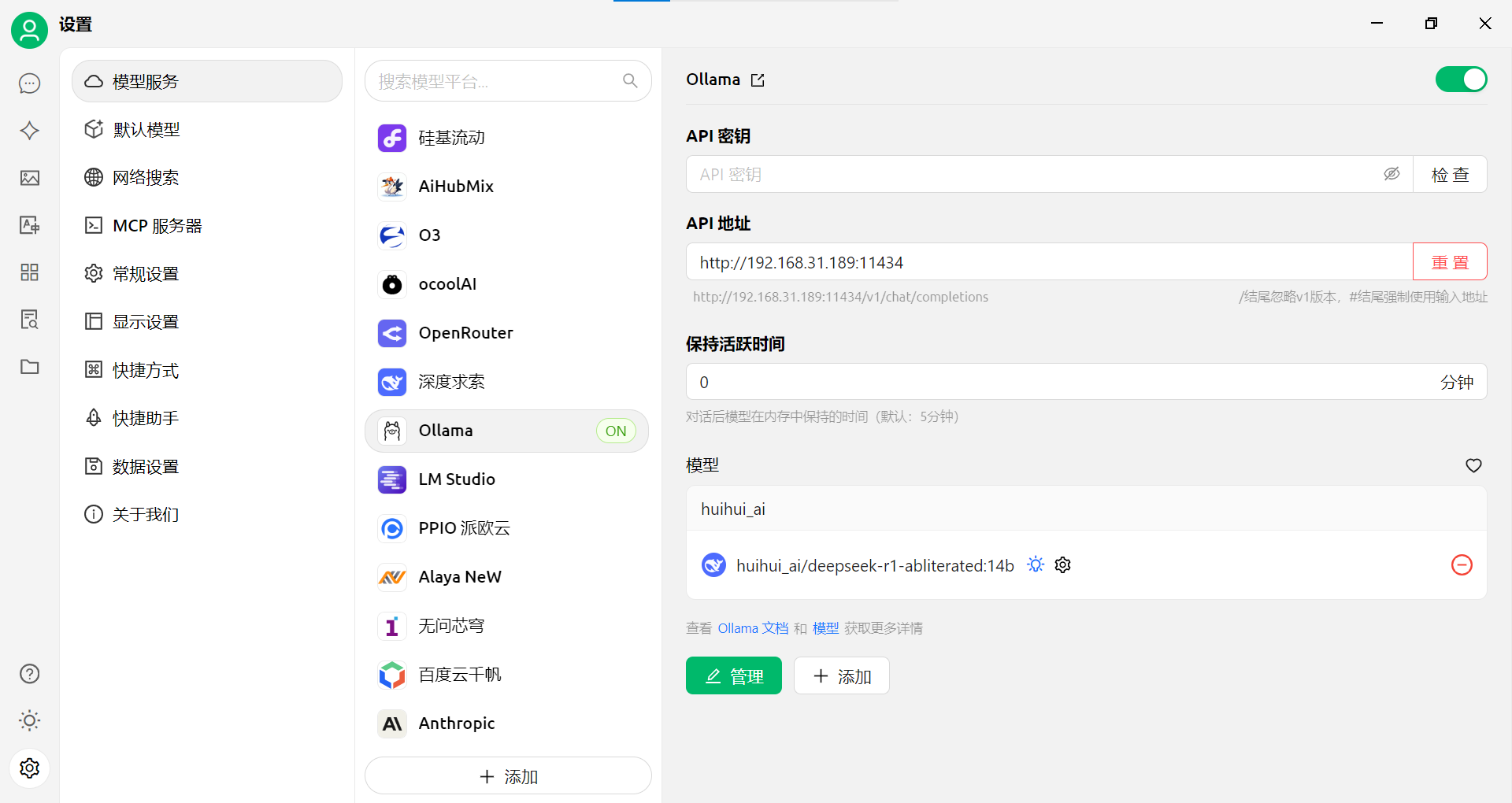

Cherry Studio:

评论